Intelligenza Artificiale e Salute: Diagnosi Accurate o Rischio di Allucinazioni Mediche?

2025-08-08

Il Post

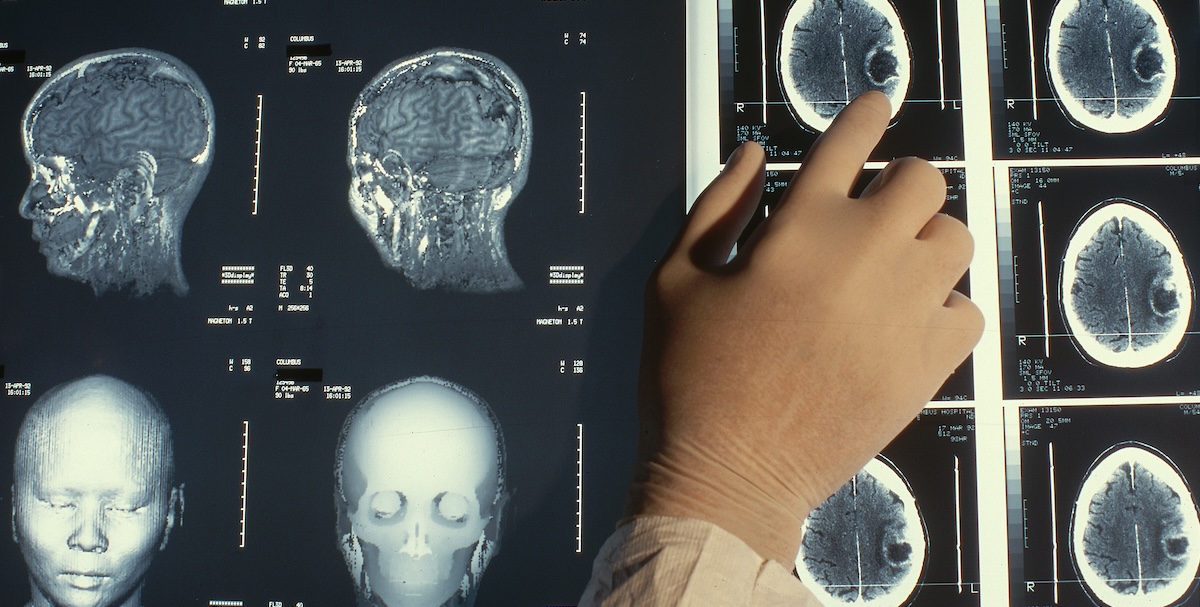

L'intelligenza artificiale (IA) sta rivoluzionando il settore sanitario, promettendo diagnosi più rapide e terapie personalizzate. Ma cosa succede quando l'IA 'allucina', inventando malattie o dettagli anatomici inesistenti? Esploriamo i benefici, i rischi e le sfide etiche dell'IA applicata alla nostra salute.

L'IA in Sanità: Un Futuro Promettente

L'integrazione dell'IA nel settore sanitario non è più fantascienza. Dalle analisi di immagini mediche alla scoperta di nuovi farmaci, l'IA sta dimostrando un potenziale enorme. I sistemi di IA possono analizzare grandi quantità di dati, identificare pattern che sfuggono all'occhio umano e fornire ai medici informazioni preziose per prendere decisioni più informate. Questo si traduce in diagnosi più accurate, trattamenti più efficaci e una maggiore cura del paziente. Ad esempio, l'IA è già utilizzata per rilevare precocemente il cancro al seno attraverso l'analisi di mammografie, con una precisione spesso superiore a quella dei radiologi umani.

Il Fenomeno delle 'Allucinazioni' dell'IA

Tuttavia, l'entusiasmo per l'IA in sanità deve essere temperato da una consapevolezza dei suoi limiti. Un problema emergente è quello delle 'allucinazioni' dell'IA, ovvero la tendenza dei modelli linguistici di generare informazioni false o fuorvianti. Nel contesto medico, questo può avere conseguenze gravi. Immaginate un sistema di IA che, durante una diagnosi, inventa una malattia rara o descrive dettagli anatomici inesistenti. Un medico inesperto potrebbe essere indotto a credere a queste informazioni errate, portando a trattamenti inappropriati o addirittura dannosi.

Cause e Soluzioni

Le cause di queste allucinazioni sono molteplici. Possono derivare da dati di addestramento incompleti o distorti, da un'eccessiva dipendenza da pattern statistici piuttosto che dalla comprensione del contesto medico, o da una mancanza di trasparenza nel funzionamento interno dei modelli di IA. Per mitigare questo rischio, è fondamentale sviluppare sistemi di IA più robusti e affidabili, basati su dati accurati e verificati. È inoltre necessario implementare meccanismi di controllo e validazione, che consentano ai medici di verificare l'accuratezza delle informazioni fornite dall'IA. La collaborazione tra medici e ingegneri dell'IA è essenziale per garantire che i sistemi di IA siano utilizzati in modo sicuro ed efficace.

Considerazioni Etiche e Regolamentari

L'utilizzo dell'IA in sanità solleva anche importanti questioni etiche e regolamentari. Chi è responsabile in caso di diagnosi errata o trattamento inappropriato causato da un errore dell'IA? Come proteggere la privacy dei dati dei pazienti? È necessario stabilire linee guida chiare e rigorose per lo sviluppo e l'implementazione dell'IA in sanità, garantendo che i benefici siano accessibili a tutti e che i rischi siano minimizzati. La trasparenza e l'accountability sono principi chiave da tenere a mente.

Il Futuro dell'IA in Sanità: Un Approccio Collaborativo

L'IA ha il potenziale per trasformare radicalmente il settore sanitario, ma è fondamentale affrontare le sfide e i rischi che essa comporta. Un approccio collaborativo, che coinvolga medici, ingegneri, eticisti e regolatori, è essenziale per garantire che l'IA sia utilizzata in modo responsabile e a beneficio di tutti. Il futuro della sanità è probabilmente un futuro in cui l'IA e l'intelligenza umana lavorano insieme, sfruttando al meglio le capacità di entrambe per migliorare la salute e il benessere delle persone.